Proton lança alternativa ao Excel e Google Sheets focada em privacidade

Proton lança alternativa ao Excel e Google Sheets focada em privacidade

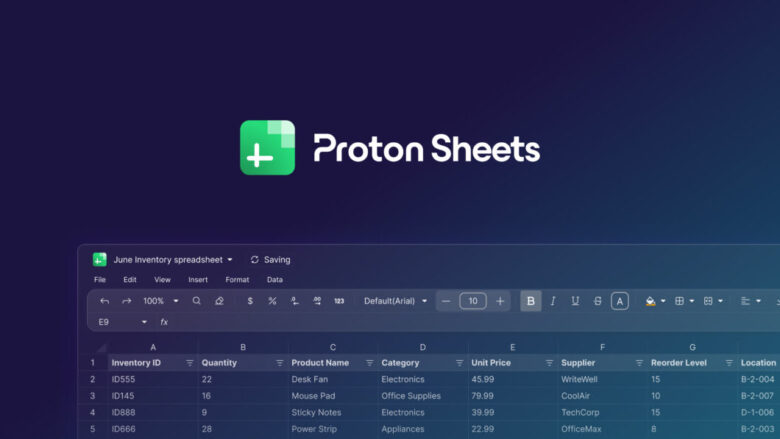

Proton Sheets tem criptografia ponta a ponta (imagem: divulgação/Proton)

Resumo

Proton Sheets é um serviço de planilhas online com criptografia ponta a ponta, disponível gratuitamente para usuários do Proton Drive;

Novidade suporta fórmulas comuns e formatos populares como CSV e XLS, permitindo importação fácil e edição colaborativa em tempo real;

Criptografia impede até que a própria Proton acesse o conteúdo das planilhas.

A Proton começou suas operações com um serviço de e-mail, em 2014. Desde então, a companhia vem aumentando seu leque de ferramentas. A mais recente atende pelo nome de Proton Sheets: trata-se de um serviço de planilhas online que tem como diferencial um mecanismo de criptografia ponta a ponta.

O novo serviço suporta as fórmulas mais usadas em outros serviços do tipo para evitar que o usuário tenha uma extensa curva de aprendizado. Além disso, os formatos mais populares, como CSV e XLS, são suportados.

Arquivos nesses padrões podem ser importados facilmente para o Proton Sheets, o que torna a novidade uma alternativa em potencial a ferramentas de planilhas como Google Sheets e, claro, Microsoft Excel.

Outro atributo está na possibilidade de equipes trabalharem juntas nas mesmas planilhas, inclusive com possibilidade de edição em tempo real — as atualizações aparecem para todos os participantes, instantaneamente.

Proton Sheets suporta múltiplos usuários (imagem: divulgação/Proton)

Nesse sentido, também é possível definir níveis de acesso, de modo que determinadas pessoas tenham autorização para editar ou somente visualizar planilhas específicas, por exemplo.

Mas o ponto forte do Proton Sheets é mesmo a criptografia ponta a ponta. Esse recurso impede até que a própria Proton acesse o conteúdo das planilhas ou que os dados sejam utilizados para treinamento de modelos de inteligência artificial, de acordo com a empresa.

É por isso que criamos o Proton Sheets: uma alternativa robusta e focada na privacidade que coloca o controle, a segurança e a confiança de volta onde pertencem — firmemente nas mãos dos usuários.

Anant Vijay Singh, chefe de produto do Proton Drive

Proton Sheets usa fórmulas já conhecidas em outros serviços (imagem: divulgação/Proton)

Quem pode usar o Proton Sheets?

Qualquer pessoa que tiver uma conta no Proton Drive pode usar o Proton Sheets, gratuitamente. O novo serviço também está disponível para organizações que têm planos como o Proton Drive Professional ou o Proton Business Suite.

A novidade aumenta a capacidade da Proton de disputar espaço no segmento de ferramentas de produtividade online com gigantes como Google e Microsoft. A companhia já oferecia serviços como Proton Docs (editor de textos), Proton Calendar (agenda) e Proton Meet (para reuniões por vídeo).

Proton lança alternativa ao Excel e Google Sheets focada em privacidade

Proton lança alternativa ao Excel e Google Sheets focada em privacidade

Fonte: Tecnoblog