OpenAI lança Sora 2 e app para competir com o TikTok

OpenAI lança Sora 2 e app para competir com o TikTok

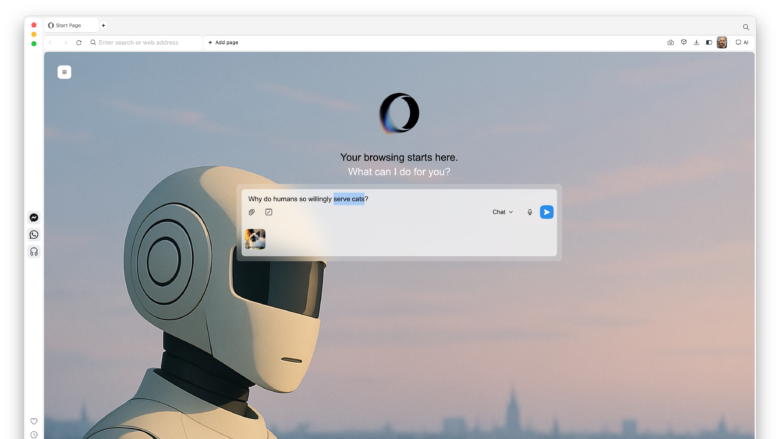

App Sora permite criar, remixar e compartilhar vídeos de IA (imagem: reprodução)

Resumo

OpenAI lançou o Sora 2, novo modelo de IA para geração de vídeos, e o app Sora para iPhone.

O Sora 2 traz simulação física avançada, áudio sincronizado e consistência em múltiplas cenas.

O app gera vídeos com IA e inclui recursos como Cameos, que insere usuários em cenas criadas artificialmente.

O aplicativo começará a ser liberado nos EUA e Canadá, através de uma lista de espera, e ainda não tem uma previsão de chegada a outras regiões.

A OpenAI anunciou nesta terça-feira (30/09) o lançamento do Sora 2, a nova versão do seu modelo de inteligência artificial para criação de vídeos. A novidade chega junto com o app Sora para iPhone, que lembra o TikTok.

O aplicativo tem um feed que é alimentado inteiramente com vídeos gerados pela IA da empresa, e o anúncio ocorre pouco depois do vazamento de informações sobre o app, reportadas inicialmente pela revista Wired.

Vídeos mais realistas e áudio sincronizado

This is the Sora app, powered by Sora 2.Inside the app, you can create, remix, and bring yourself or your friends into the scene through cameos—all within a customizable feed designed just for Sora videos.See inside the Sora app pic.twitter.com/GxzxdNZMYG— OpenAI (@OpenAI) September 30, 2025

O Sora 2 é descrito pela OpenAI como um salto comparável à evolução do GPT-1 para o GPT-3.5 no ChatGPT. A empresa afirma que o sistema possui capacidades avançadas de simulação de mundo, resultando em vídeos com maior precisão física e realismo.

Diferente de modelos anteriores, o novo modelo consegue simular mais interações físicas e integra a geração de áudio sincronizado, incluindo diálogos, efeitos sonoros e paisagens de fundo.

O controle sobre a criação também foi expandido, permitindo que o modelo siga instruções complexas que abrangem múltiplas cenas, mantendo a consistência de objetos e personagens.

Rede social de conteúdo gerado por IA

O novo modelo vai alimentar o aplicativo social da empresa, o Sora. Com uma interface que remete a outras plataformas de feed vertical, a interação será por meio de criações, remixes, curtidas e comentários.

Uma das características únicas é a ausência de upload de mídias externas: todos os vídeos que alimentam a rede são gerados internamente com o Sora 2, a partir de comandos de texto.

Outra novidade do app é o recurso Cameos. Depois de verificar identidade com imagem e voz, o usuário pode se colocar — ou inserir amigos — em qualquer cena criada pela IA. De acordo com a OpenAI, o controle é total: é possível revogar o uso da própria imagem ou excluir um vídeo a qualquer momento, mesmo que ele tenha sido gerado por outra pessoa.

“Acreditamos que um aplicativo social desenvolvido em torno desse recurso de ‘participações especiais’ é a melhor maneira de vivenciar a magia do Sora 2”, afirma a equipe por trás do Sora em comunicado oficial.

A OpenAI também publicou um artigo detalhando seu compromisso com o bem-estar dos usuários. A empresa afirma que o algoritmo do feed foi projetado para “maximizar a criação” em vez de tempo gasto na plataforma, com ferramentas para controlar e instruir recomendações de conteúdo com linguagem natural.

A segurança dos adolescentes também recebeu atenção especial. O aplicativo implementará limites padrão de visualização diária para este público e permissões mais restritas para o uso do Cameos.

Além disso, o app do Sora será integrado aos controles parentais do ChatGPT, permitindo que os pais desativem a rolagem infinita, a personalização do feed e gerenciem as configurações de mensagens diretas de seus filhos.

Em relação à monetização, a OpenAI declarou que, por enquanto, o único plano é, eventualmente, oferecer a opção de pagar por gerações de vídeo extras caso a demanda exceda a capacidade computacional.

Quando estará disponível?

Aplicativo chega para iOS nos EUA e Canadá (imagem: Gabriel Sérvio/Tecnoblog)

O novo aplicativo Sora será liberado inicialmente para iPhone nos Estados Unidos e Canadá, e já está disponível para download na App Store desses países. O acesso será fornecido gradualmente para quem se inscrever na lista de espera.

Inicialmente, o uso será gratuito. Assinantes do ChatGPT Pro terão acesso a um modelo experimental de alta qualidade, chamado Sora 2 Pro. A OpenAI também planeja disponibilizar o Sora 2 via API para desenvolvedores no futuro.

Até o momento, a OpenAI não divulgou um cronograma ou previsão para a chegada de uma versão para Android.

Com informações da OpenAI

OpenAI lança Sora 2 e app para competir com o TikTok

OpenAI lança Sora 2 e app para competir com o TikTok

Fonte: Tecnoblog