Claude agora pode controlar seu Mac pelo iPhone

Claude agora pode controlar seu Mac pelo iPhone

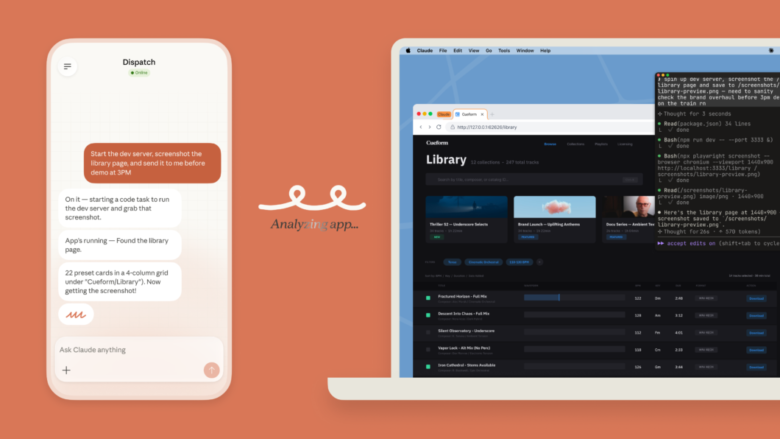

Novidade ainda é restrita ao ecossistema Apple (imagem: reprodução/Anthropic)

Resumo

Anthropic atualiza ferramentas Claude Cowork e Claude Code com controle remoto de Mac.

IA agora pode executar ações no macOS e automatizar tarefas complexas mesmo à distância.

Por enquanto, funcionalidade é restrita ao ecossistema Apple e chega em preview para assinantes pagos.

A Anthropic anunciou uma atualização de peso para as ferramentas Claude Cowork e Claude Code. A inteligência artificial da empresa agora consegue assumir o controle de um Mac remotamente para executar tarefas. O recurso permite que a IA aponte, clique, digite e até navegue pela interface do macOS, concluindo tarefas mesmo longe do computador.

A novidade funciona integrada ao Dispatch, outra funcionalidade recente que viabiliza a atribuição de processos entre diferentes aparelhos. Segundo a Anthropic, o sistema funciona da seguinte maneira: um usuário pode solicitar uma tarefa complexa ao Claude pelo aplicativo para iPhone; em seguida, a IA executa os comandos necessários no Mac que ficou em casa ou no escritório.

O modelo foi desenhado para atuar como um assistente. Em uma das demonstrações publicadas no YouTube, a IA recebe a instrução para exportar uma apresentação de vendas no formato PDF e anexá-la a um convite de reunião. A partir daí, o Claude realiza os cliques na interface do sistema de forma independente.

Como o Claude navega pelos aplicativos?

Para interagir com o sistema, o Claude prioriza integrações diretas com ferramentas como Slack ou Google Agenda. Quando essas pontes não existem, a IA passa a interpretar e controlar a tela. Ela rola páginas, clica em botões, abre arquivos e usa o navegador como um humano. O único requisito técnico é que o aplicativo desktop do Claude esteja aberto no macOS.

Apesar do avanço, a desenvolvedora é transparente quanto às atuais limitações. A Anthropic ressalta que o uso de computadores por modelos de IA ainda está em um estágio inicial e a ferramenta pode cometer erros de execução ou necessitar de uma segunda tentativa para finalizar comandos difíceis.

Para reduzir riscos, a IA sempre solicitará o aval do usuário antes de acessar um aplicativo novo ou instalar ferramentas. A companhia também implementou um sistema de verificação automático focado em detectar e neutralizar atividades perigosas. Outra recomendação oficial é evitar expor o recurso a dados sensíveis ou confidenciais, pelo menos neste período inicial.

A novidade já está disponível em formato de pré-visualização (preview) para assinantes dos planos pagos Claude Pro e Claude Max.

Claude solicita permissão do usuário para acessar novos aplicativos (imagem: reprodução/Anthropic)

Recurso segue tendência do OpenClaw

A nova funcionalidade do Claude segue uma tendência do mercado de agentes autônomos, esbarrando em comparações com o OpenClaw. O projeto de código aberto viralizou no início de 2026 por se conectar a aplicativos de mensagens, como WhatsApp e Telegram, utilizando um sistema baseado em plugins (“skills”) para automação e gerenciamento de arquivos.

Mas, aqui, há uma diferença no ecossistema. Enquanto o OpenClaw é multiplataforma (suportando macOS, Windows e Linux) e altamente personalizável, a versão da Anthropic aposta em um ambiente mais restritivo e controlado, rodando, até o momento, apenas nos computadores da Apple.

A atualização reforça a lista de melhorias da Anthropic, que também liberou recentemente uma ferramenta oficial de importação de memória. Ela permite transferir históricos de conversas de outras IAs concorrentes, eliminando a necessidade de começar do zero após migrar de serviço.

Claude agora pode controlar seu Mac pelo iPhone

Claude agora pode controlar seu Mac pelo iPhone

Fonte: Tecnoblog